MUSCLE(Model Update Strategy for Compatible LLM Evolution)是由苹果公司开发的一种用于大语言模型(LLMs)更新的训练策略。旨在减少用户在使用更新后的大语言模型时所面临的麻烦。每次模型更新后,用户不需要再重新适应新模型的变化,从而减少了由于模型更新带来的困扰。

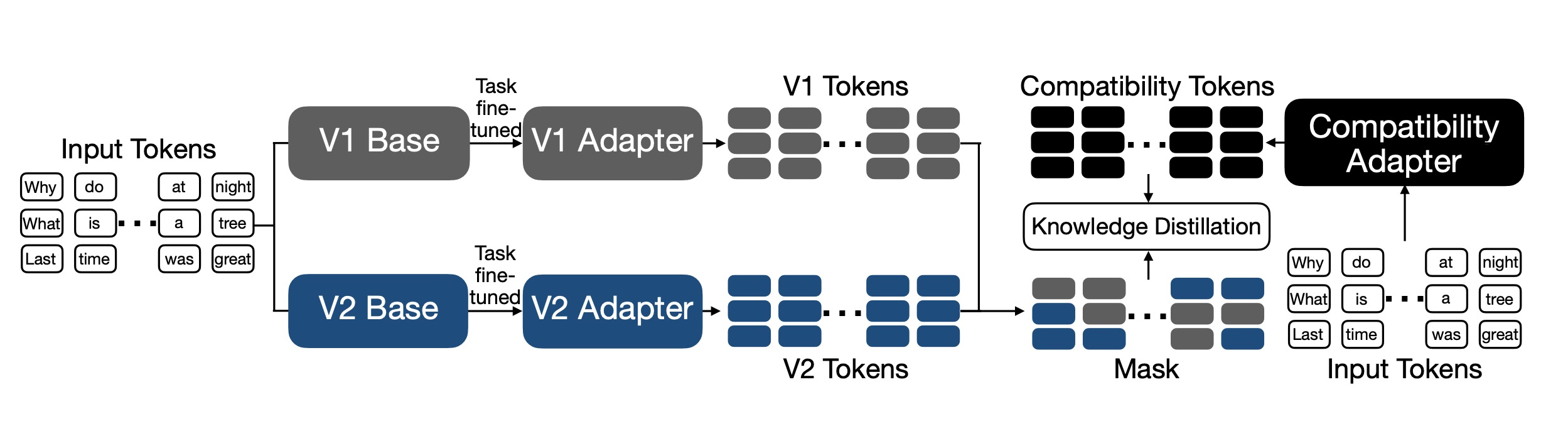

该策略的核心是通过训练一个兼容性适配器,使模型在更新后能够尽量保持与旧版本模型的兼容性,从而减少预测结果的不一致性,特别是减少所谓的“负翻转”现象。

MUSCLE通过知识蒸馏的方法,将旧模型的知识部分转移到新模型中,确保新模型在性能提升的同时,保持对旧模型的兼容性。

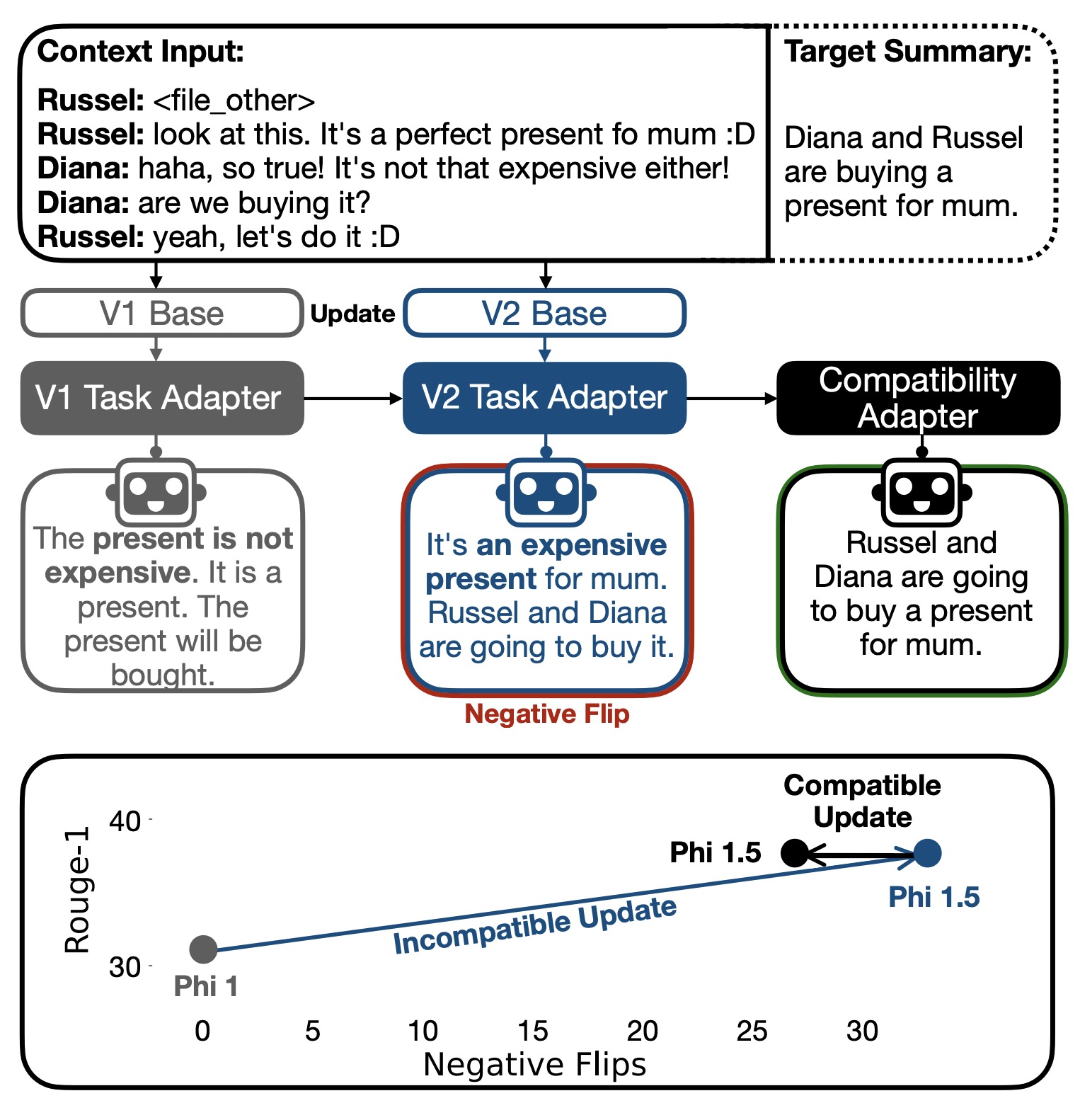

图中展示了一个真实的模型更新例子,其中发生了负翻转现象。具体来说,在对话摘要任务中,旧模型能够正确生成的摘要在新模型中变得错误。

解决了什么问题

1. 负翻转现象

- 负负翻转现象指的是在模型更新后,先前模型能够正确预测的实例在新模型中变得错误。这种现象会导致用户体验下降,因为用户需要重新适应新模型的行为。

- 负翻转现象会导致用户体验不佳,因为用户需要重新适应和理解新模型的行为,增加了使用成本和心理负担。

2. 用户适应成本

- 每次模型更新后,用户需要重新调整他们对模型功能和性能的期望和理解,这被称为用户适应成本。

- 频繁的模型更新如果没有考虑兼容性,会增加用户的适应成本,导致用户满意度下降。

3. 模型更新一致性

- 模型更新一致性是指模型在更新后能够保持与旧版本模型相似的行为和性能。

- 现有的方法在提升模型性能时往往忽略了与旧版本模型的一致性,这会导致预测结果的突然变化,影响用户的使用体验。

MUSCLE的具体方法

- 兼容性适配器的训练:MUSCLE的核心是训练一个兼容性适配器,使得在更新模型基础部分后,任务特定的适配器可以减少负翻转现象并保持性能提升。

- 适配器初始化:兼容性适配器从新版本模型的任务适配器初始化,然后进一步对其进行微调。微调过程中,兼容性适配器会对齐新旧模型的预测,确保新模型能够继承旧模型的正确预测行为。

- 蒸馏知识:采用知识蒸馏的方法,将旧模型的部分知识转移到新模型中。知识蒸馏通过最小化学生模型(新模型)和教师模型(旧模型)之间的KL散度来实现,这样新模型可以在保留自身性能提升的同时,尽可能模仿旧模型的预测行为。

- 掩码策略:在微调过程中,MUSCLE采用了一种掩码策略来决定在什么时候对齐新模型和旧模型的预测。具体来说,当新模型的预测是错误的时,它会对齐到旧模型的预测,从而减少负翻转现象。

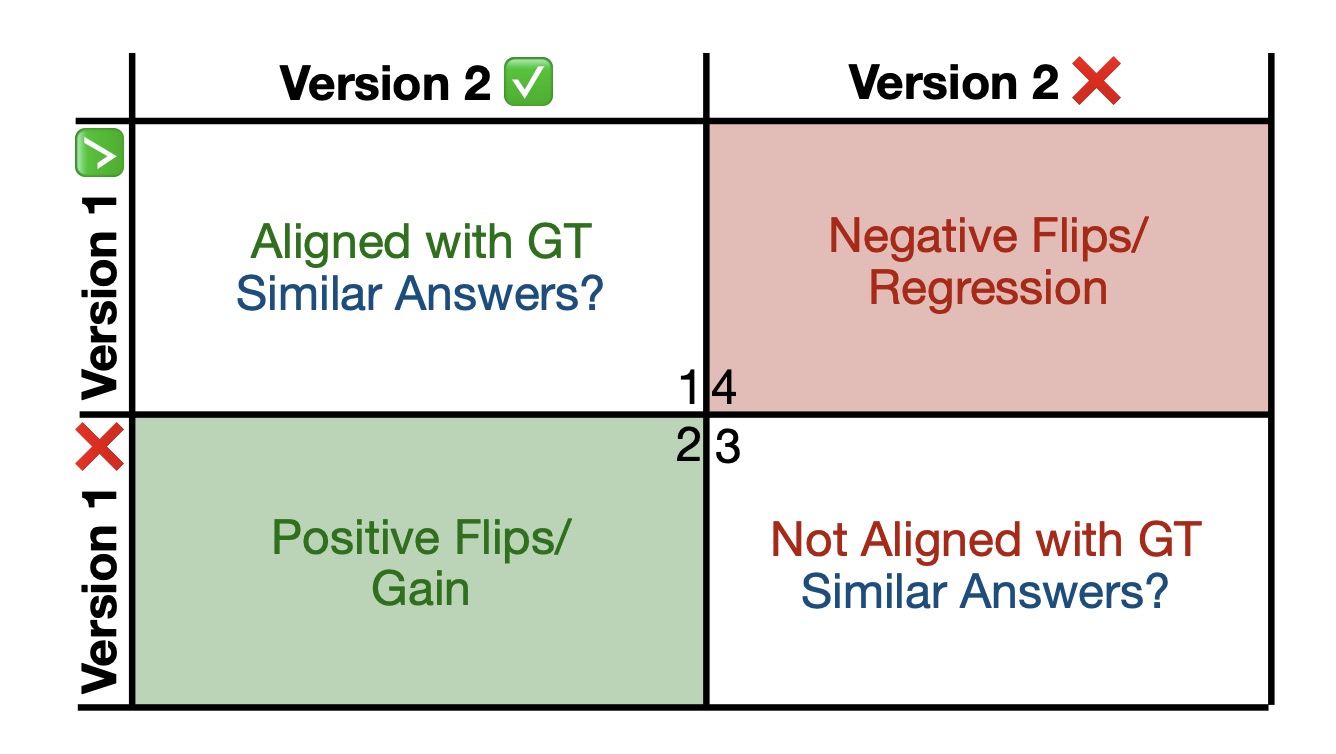

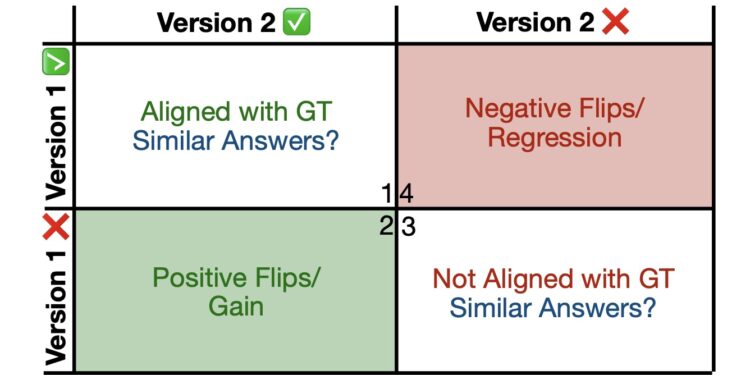

模型更新时样本的四种可能性

在模型更新时,每个样本可能出现以下四种情况。这些情况被分为四个象限(Quadrants),分别表示正翻转、负翻转以及其他情况。

象限 1(Quadrant 1)

- 情况:新旧模型都正确。

- 意义:这表示模型更新没有影响到该样本的正确预测,保持了一致性。

象限 2(Quadrant 2)

- 情况:旧模型错误,新模型正确。

- 意义:这是正翻转,表示模型更新带来了性能提升。此类情况越多,说明模型更新越成功。

象限 3(Quadrant 3)

- 情况:新旧模型都错误。

- 意义:虽然模型在这个样本上的表现都不正确,但如果新旧模型在错误上保持一致(即犯相同的错误),这有助于用户更容易适应模型更新。这是因为用户可能已经开发了应对模型错误的方法,一致性的错误可以减少用户的不适感。

象限 4(Quadrant 4)

- 情况:旧模型正确,新模型错误。

- 意义:这是负翻转,表示模型更新导致了性能下降。这种情况会降低用户满意度,应尽量减少。

评价指标

评价指标

- 正翻转率(PFR):象限 2 中的实例比例。正翻转率越高,说明模型更新带来的性能提升越大。

- 负翻转率(NFR):象限 4 中的实例比例。负翻转率越低,说明模型更新对性能的负面影响越小。

- 一致性错误(Consistent Mistakes):象限 3 中,新旧模型犯相同错误的比例。通过鼓励一致性错误,可以减少用户适应成本,提高用户满意度。

MUSCLE方法的应用

MUSCLE通过训练兼容性适配器,减少象限 4 的实例数量,增加象限 2 的实例数量,同时保持象限 3 中的错误一致性。

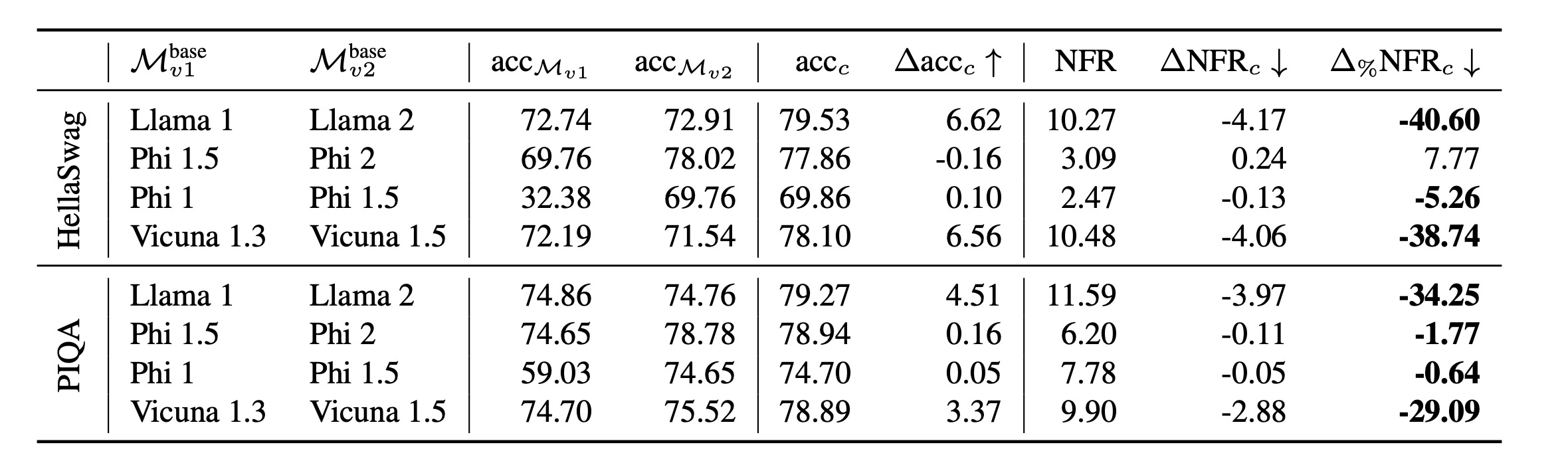

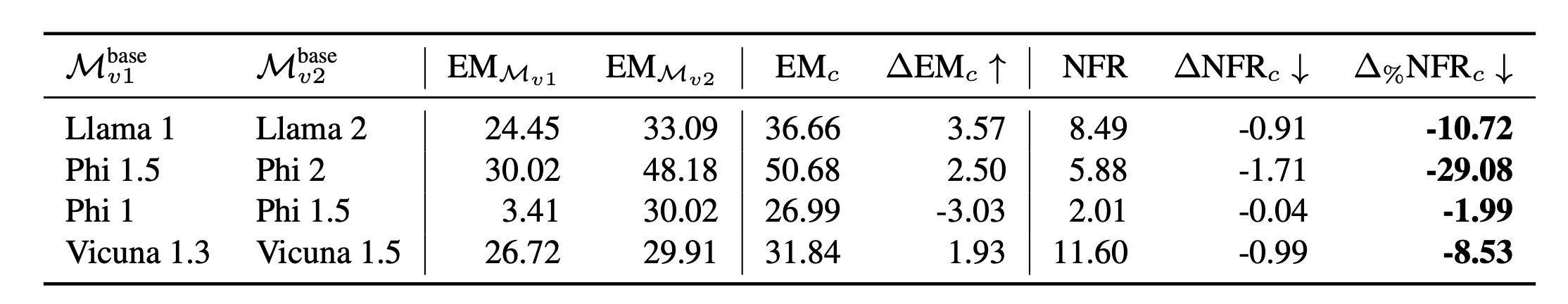

实验结果

- 负翻转现象减少

- MUSCLE方法在多个任务上显著减少了负翻转现象。例如,在多选任务(如PIQA和HellaSwag)中,负翻转率减少了34%至40%;在数学推理任务(GSM8K)中,负翻转率减少了10%至29%;在对话摘要任务(SAMSum)中,负翻转率减少了15%至27%。

- 通过减少负翻转,用户在模型更新后不需要重新适应新的模型行为,从而提高了用户体验。

- 性能提升

- 在大多数任务上,MUSCLE方法不仅减少了负翻转,还保持或提升了模型的整体性能。例如,在PIQA任务中,使用MUSCLE的模型准确率提升了4.51%;在GSM8K任务中,准确率提升了10.72%。

- 对于生成任务(如对话摘要任务),MUSCLE方法也提高了ROUGE-1得分,显示了其在生成任务中的有效性。

Support authors and subscribe to content

This is premium stuff. Subscribe to read the entire article.

借助 AI 艺术的力量,充分发挥自己的创造力,使用我们免费提供的 AI 图片生成工具,创作独一无二的 AI 照片。只要输入描述性提示,即可开始使用。