一文带你看懂OpenAI-Sora生成视频的原理

发布时间:2024年06月06日

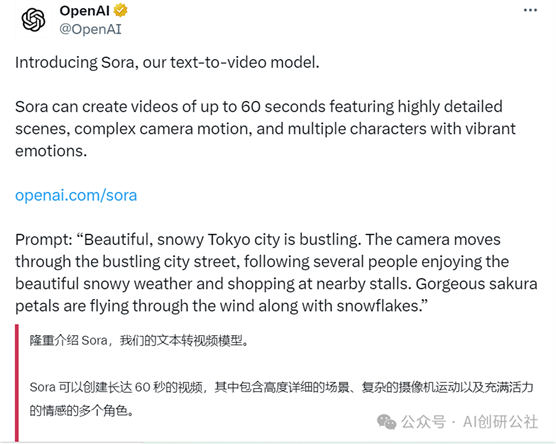

OpenAI非常突然地发布了其首款AI视频生成模型——“Video

generation models as world simulators”(作为世界模拟器的视频生成模型),名字叫做Sora,在粤语中有点像“傻啦”,可以创建长达 60 秒的视频,其中包含高度详细的场景、复杂的摄像机运动以及充满活力的情感的多个角色。这标志着我们如何理解和创造虚拟世界的方式即将迎来根本性的变革。 OpenAI在X上发布消息

OpenAI在X上发布消息

在此之前,尽管Runway、Pika、Kreadoai、Moonvalley、Pixverse等早已推出了各具特色的视频生成工具,但OpenAI的Sora视频生成模型如同一颗新星,以其逼真、流畅、长达1分钟视频生成长度的特点和非常显著的效果提升,足以秒杀一众弟弟。

想象一下,如果我们能够通过简单的描述就创造出动态的、互动的三维世界,那么教育、娱乐乃至科学研究将迎来怎样的变革?这项技术背后的原理是什么,又将如何影响我们的未来?这时候肯定有一大堆博主又要惊呼“太炸裂了”、“XXX要失业了”,但我想,再牛逼也是别人牛逼,你炸裂365天都没用,我们还是首先多从原理上去看看OpenAI的Sora模型是怎么生成这些视频的吧。推荐大家看看OpenAI关于Sora的研究报告:https://openai.com/research/video-generation-models-as-world-simulators#fn-15下面,本文将用最容易理解的文字,为你深度探讨OpenAI的Sora模型生成视频的原理,小白也能看得懂!

「从视觉数据到补丁」

就像拼积木游戏

假如你手里有一盒五彩缤纷的积木,每个积木都有它独特的形状和颜色。现在,让我们把这些积木拼凑起来,不是随意拼凑,而是按照一张精美的图画的样子。这张图画就是你想要讲述的故事,而每个积木就是这个故事中不可或缺的一部分。Sora模型处理视频数据的过程,就可以用拼积木的游戏来形象地比喻。接下来,我们就来探究这些多彩积木——也就是视频中的“补丁”。首先,我们需要明确一个概念,那就是“补丁”。在Sora模型的语境中,补丁并不是我们平时理解的用来修补东西的片材,而是视频画面中的一小块信息单元。就好比我们看到的一张静态图像,可以分割成一个个小格子,每个小格子都承载了整体图像的一部分信息;视频中的补丁也是如此。这些补丁包括了色彩、光线、形状、甚至是物体动态的片段。但Sora模型处理视频的方式,远比拼凑静态图像更为复杂。它必须理解每个补丁在时间上的变化,这就像是要求你在拼积木的同时,还得让这些积木根据某种规律动起来,形成一部动画。想要做到这一点,模型需要进行两项关键任务:识别和预测。识别就是要分辨出每个补丁的特性和含义,预测则是预想这些补丁在未来的几帧中将如何变化。Sora模型的识别功能使它能够把一长串视频分解成一系列连续的画面,然后再把每个画面继续细分成多个补丁。这个过程有点像是儿童识图游戏的高级版,每个补丁都需要被识别出其所代表的内容——是天空、是大楼、还是人物的眼睛?一旦识别完成,这些补丁就如同切好的拼图片,准备被正确放置。接下来是预测环节,Sora模型将结合它对现实世界的理解,来预测这些补丁下一刻应该出现在何处,以及它们之间将如何相互作用。举个例子,如果我们有一个补丁显示一个人正在跑步,模型会通过学习人类跑步的动态模式,来预测下一系列补丁中这个人的位置和姿态的变化。当然,在这个拼积木的比喻中,我们也要注意到不同之处。与手工拼积木相比,Sora模型处理的补丁需要符合物理规律和逻辑连贯性,它们之间的关系远比简单的拼凑更为复杂。此外,Sora模型在拼接补丁时还要考虑到画面的美感和故事的流畅度,就像是在确保拼图正确的基础上,还要创作出一部艺术电影。现在,我们已经了解了Sora模型如何通过视频补丁拼凑起复杂的视觉故事,接下来就是让这些故事在节省资源的同时还能流畅表达的挑战。这就引入了视频压缩网络的概念,它让Sora模型在用尽可能少的信息传达尽可能多的内容方面变得高效和灵活,这一点,我们将在下一部分进行深入探讨。

假如你手里有一盒五彩缤纷的积木,每个积木都有它独特的形状和颜色。现在,让我们把这些积木拼凑起来,不是随意拼凑,而是按照一张精美的图画的样子。这张图画就是你想要讲述的故事,而每个积木就是这个故事中不可或缺的一部分。Sora模型处理视频数据的过程,就可以用拼积木的游戏来形象地比喻。接下来,我们就来探究这些多彩积木——也就是视频中的“补丁”。首先,我们需要明确一个概念,那就是“补丁”。在Sora模型的语境中,补丁并不是我们平时理解的用来修补东西的片材,而是视频画面中的一小块信息单元。就好比我们看到的一张静态图像,可以分割成一个个小格子,每个小格子都承载了整体图像的一部分信息;视频中的补丁也是如此。这些补丁包括了色彩、光线、形状、甚至是物体动态的片段。但Sora模型处理视频的方式,远比拼凑静态图像更为复杂。它必须理解每个补丁在时间上的变化,这就像是要求你在拼积木的同时,还得让这些积木根据某种规律动起来,形成一部动画。想要做到这一点,模型需要进行两项关键任务:识别和预测。识别就是要分辨出每个补丁的特性和含义,预测则是预想这些补丁在未来的几帧中将如何变化。Sora模型的识别功能使它能够把一长串视频分解成一系列连续的画面,然后再把每个画面继续细分成多个补丁。这个过程有点像是儿童识图游戏的高级版,每个补丁都需要被识别出其所代表的内容——是天空、是大楼、还是人物的眼睛?一旦识别完成,这些补丁就如同切好的拼图片,准备被正确放置。接下来是预测环节,Sora模型将结合它对现实世界的理解,来预测这些补丁下一刻应该出现在何处,以及它们之间将如何相互作用。举个例子,如果我们有一个补丁显示一个人正在跑步,模型会通过学习人类跑步的动态模式,来预测下一系列补丁中这个人的位置和姿态的变化。当然,在这个拼积木的比喻中,我们也要注意到不同之处。与手工拼积木相比,Sora模型处理的补丁需要符合物理规律和逻辑连贯性,它们之间的关系远比简单的拼凑更为复杂。此外,Sora模型在拼接补丁时还要考虑到画面的美感和故事的流畅度,就像是在确保拼图正确的基础上,还要创作出一部艺术电影。现在,我们已经了解了Sora模型如何通过视频补丁拼凑起复杂的视觉故事,接下来就是让这些故事在节省资源的同时还能流畅表达的挑战。这就引入了视频压缩网络的概念,它让Sora模型在用尽可能少的信息传达尽可能多的内容方面变得高效和灵活,这一点,我们将在下一部分进行深入探讨。

「视频压缩网络」

用更少的信息说更多的话

在我们继续探讨Sora模型如何将时间与空间编织成一部影片之前,我们需要理解一项关键的技术——视频压缩网络。这个网络在整个生成过程中起到了极其重要的角色,就像是一位讲故事的大师,它擅长用最简洁的语句来讲述引人入胜的故事。那么,视频压缩网络究竟是如何做到的呢?首先,我们要知道,视频内容的生成过程中涉及到大量的数据。一个短短的视频片段,就包含了成千上万的像素,而每个像素都承载着颜色和亮度的信息。如果要将这些数据毫无节制地传输和存储,那将需要巨大的带宽和存储空间,而这对于任何系统来说都是一个巨大的挑战。这就是视频压缩网络闪亮登场的时刻,它能够在不牺牲视频质量的前提下,极大地减少数据的大小。想象一下,如果我们有一本内容繁多、篇幅庞大的小说,但我们需要在短短几分钟内向朋友讲述其精彩之处。我们会选择最关键的情节,最生动的描写,最突出的角色进行讲述,而略去那些不那么关键的细节。视频压缩网络也是采取类似的方法,它寻找视频中的重要信息——色彩变化剧烈的区域,或者是动作快速的部分,并对这些部分保持高质量的同时,去除那些重复或不那么重要的信息。这样一来,视频文件就变得更加小巧,传输起来更加迅速,存储起来也更加节省空间。要实现这样的压缩效果,Sora模型采用了高级的算法,这些算法能够理解视频内容的结构,区分哪些是可以压缩的冗余数据,哪些是必须保留的关键数据。举个例子,视频中一个人物的背景可能在很多帧中保持不变,视频压缩网络会识别出这一点,并仅存储背景的关键帧,而不是存储每一帧中几乎相同的背景。同样,如果一个场景中有一片树林,而树林的大部分视觉信息在多个帧中是重复的,网络会智能地将这些重复信息编码成一个更为简洁的表达形式。不过,视频压缩并不是一项无损的过程。它需要在压缩效率和视频质量之间找到一个平衡点。过度压缩可能会导致视频中出现模糊或失真,而这会影响观众的观赏体验。因此,Sora模型需要非常精细地调整压缩参数,以确保最终的视频既清晰又流畅。此外,视频压缩网络还具备一项重要功能,那就是预测编码。在视频流中,许多帧与前一帧高度相似。网络通过预测接下来的帧可能出现的内容,并将这个预测与实际内容进行对比,只记录下两者之间的差异,从而进一步减少了需要存储和传输的数据量。总的来说,视频压缩网络就像是那些能够将长篇大论浓缩成精彩简介的文学编辑,它通过智能地剪裁和编排数据,确保了Sora模型能在资源有限的情况下,依旧能够高效地生成引人入胜的视频内容。现在,我们来看看Sora模型是如何处理那些跨越时间和空间的补丁,编织出既真实又富有想象力的故事画面。

在我们继续探讨Sora模型如何将时间与空间编织成一部影片之前,我们需要理解一项关键的技术——视频压缩网络。这个网络在整个生成过程中起到了极其重要的角色,就像是一位讲故事的大师,它擅长用最简洁的语句来讲述引人入胜的故事。那么,视频压缩网络究竟是如何做到的呢?首先,我们要知道,视频内容的生成过程中涉及到大量的数据。一个短短的视频片段,就包含了成千上万的像素,而每个像素都承载着颜色和亮度的信息。如果要将这些数据毫无节制地传输和存储,那将需要巨大的带宽和存储空间,而这对于任何系统来说都是一个巨大的挑战。这就是视频压缩网络闪亮登场的时刻,它能够在不牺牲视频质量的前提下,极大地减少数据的大小。想象一下,如果我们有一本内容繁多、篇幅庞大的小说,但我们需要在短短几分钟内向朋友讲述其精彩之处。我们会选择最关键的情节,最生动的描写,最突出的角色进行讲述,而略去那些不那么关键的细节。视频压缩网络也是采取类似的方法,它寻找视频中的重要信息——色彩变化剧烈的区域,或者是动作快速的部分,并对这些部分保持高质量的同时,去除那些重复或不那么重要的信息。这样一来,视频文件就变得更加小巧,传输起来更加迅速,存储起来也更加节省空间。要实现这样的压缩效果,Sora模型采用了高级的算法,这些算法能够理解视频内容的结构,区分哪些是可以压缩的冗余数据,哪些是必须保留的关键数据。举个例子,视频中一个人物的背景可能在很多帧中保持不变,视频压缩网络会识别出这一点,并仅存储背景的关键帧,而不是存储每一帧中几乎相同的背景。同样,如果一个场景中有一片树林,而树林的大部分视觉信息在多个帧中是重复的,网络会智能地将这些重复信息编码成一个更为简洁的表达形式。不过,视频压缩并不是一项无损的过程。它需要在压缩效率和视频质量之间找到一个平衡点。过度压缩可能会导致视频中出现模糊或失真,而这会影响观众的观赏体验。因此,Sora模型需要非常精细地调整压缩参数,以确保最终的视频既清晰又流畅。此外,视频压缩网络还具备一项重要功能,那就是预测编码。在视频流中,许多帧与前一帧高度相似。网络通过预测接下来的帧可能出现的内容,并将这个预测与实际内容进行对比,只记录下两者之间的差异,从而进一步减少了需要存储和传输的数据量。总的来说,视频压缩网络就像是那些能够将长篇大论浓缩成精彩简介的文学编辑,它通过智能地剪裁和编排数据,确保了Sora模型能在资源有限的情况下,依旧能够高效地生成引人入胜的视频内容。现在,我们来看看Sora模型是如何处理那些跨越时间和空间的补丁,编织出既真实又富有想象力的故事画面。

「时空潜在补丁」

时间和空间变化的预测大师

那么,我们已经了解到视频压缩网络的精妙之处,它如何让复杂的故事在数据的世界里变得简洁。现在,让我们细致探索时空潜在补丁——一项让Sora模型在创造视频时能够同时考虑时间和空间变化的技术。

就像如果我们要制作一本连环画,我们需要在每一页上绘制图案和情节,使读者在翻阅的过程中感受到故事的连贯性。每一幅画面不仅要描述一个静止的场景,还要表达出前后画面之间的动作和变化。这正是时空潜在补丁在视频生成中的角色。它们是故事的每一页,不仅捕捉了某一个瞬间的画面,还包含了时间的脉络——也就是从一个场景到下一个场景的流动。

在Sora模型中,时空潜在补丁是一系列的数据块,它们在视频每一帧中捕捉并保留了时间和空间信息。所谓的“潜在”,我们指的是补丁所包含的不仅仅是表面的图像数据,还有关于这些图像如何随时间演变的深层信息。

举个例子,当一个球从空中落下时,它在每一帧视频中的位置都在变化。如果我们只是简单地记录每一帧的图像,就像是在连环画中为球的每个位置画一个静止的画面,这还不够。我们需要的是能够感知球移动的速度和方向,甚至在球即将落地前,就能预测它的弹跳方式。时空潜在补丁就具有这样的预知能力——它们记录下球的位置、速度和方向,以及与其他物体的潜在相互作用。

那么,这些时空潜在补丁是如何工作的呢?其实,这一过程与我们日常生活中的一些经验相似。比方说,当我们看到一个人开始跑步,即使闭上眼睛,我们也能预测接下来几秒钟这个人的位置。这是因为我们的大脑自然地利用了过去的信息(人静止时的状态)和当前的信息(人开始跑动),来预测未来。Sora模型通过算法在做类似的事情,不过它预测的是每一帧画面的变化。

在处理真实世界的复杂动态时,这种能力尤为关键。想象一个更加复杂的场景:一群孩子在公园里玩耍,风筝在天空中飘扬,狗狗在旁边奔跑。要生成这样一个场景的视频,不仅要考虑每一个孩子、风筝和狗狗的动作,还要处理它们之间的相互作用。时空潜在补丁让这一切成为可能,它使得Sora能够处理这种动态环境,就像那些能够将一连串的情节和动作完美融合在一个故事中的连环画家。

这种处理时空信息的方式打开了创造性表达和技术应用的新门路。借助Sora,导演们可以在不动用真正的摄像机或演员的情况下,预览他们头脑中的场景。教育者可以创建生动的课程视频来模拟复杂的科学过程。而游戏设计师们,可以生成完整的3D场景,让玩家在一个更加真实的虚拟世界中探险。

接下来,让我们探讨Sora模型的大脑——扩展变换器,它是如何将这些时空潜在补丁巧妙组合,创造出符合我们文本提示的精彩视频。

「扩展变换器」

统筹视频生成的大脑

接上文,我们已经详细了解了时空潜在补丁如何让Sora模型精准捕捉视频中时间和空间的流转。现在,让我们揭开Sora模型的核心部件——扩展变换器,这个功能强大的组件起着至关重要的角色,相当于模型的大脑,负责整合和转化输入的数据,生成符合我们文本提示的精彩视频。

首先,来简化一下扩展变换器的概念。在人工智能的语境下,变换器(transformer)是一种特殊的算法结构,它能处理序列化的信息。最初,这种结构用于处理文本数据,比如翻译句子。不过,随着技术的演进,变换器也开始在视觉任务上大放异彩。扩展变换器就是一种经过特殊设计的变换器,它不仅可以处理文本数据,还能处理和生成复杂的视频内容。

那么,扩展变换器是如何成为视频生成中的大脑的呢?我们可以通过比喻成电影导演的工作过程来理解。一个电影导演的工作是将一个故事概念化,选择合适的场景、演员和镜头运动,最终将这个故事呈现在银幕上。扩展变换器也类似于这样的导演,它将文本描述理解为一个故事蓝图,然后决定如何将时空潜在补丁中的信息和视觉元素组合,以产生连贯的视频画面。

具体来说,扩展变换器首先会“读取”输入的文本提示,理解它所描述的动作、场景和情绪。这一点就像导演解读剧本,理解剧本中的场景设置和人物动机。紧接着,变换器开始组织和操纵时空潜在补丁,将其编排成一个整体的视频序列。这类似于导演指导演员表演,选择摄影机角度和场景布局。

在视频生成的过程中,扩展变换器还会进行一系列复杂的计算。其中包括注意力机制,这可以被看作是导演在决定何时将观众的注意力集中在某个特定的场景或演员上。同样地,变换器会判断哪些细节是故事中关键的元素,哪些是可以省略的背景信息。

为了保证生成视频的连贯性和逻辑性,扩展变换器会对各个补丁之间的关系进行推理,以确保行动的连贯性和物理规律的遵循。比如,如果文本提示涉及到一个玻璃杯从桌子上掉落的场景,变换器需要计算出杯子落地后碎裂的样子,并且这个样子要符合物理定律。正如导演需要确保电影中的动作场景真实可信一样。

另一个重要的方面是适应性。导演根据拍摄现场的实际情况调整计划,扩展变换器也能根据输入数据的特性进行调整。如果一个文本提示比较模糊或开放性很强,变换器能够使用其理解和创意来填充细节,创造出一个独特而又吸引人的故事。这就好比一位导演在面对缺乏细节的剧本时,怎样通过自己的创造力来补充和丰富故事情节。

通过上述过程,扩展变换器最终输出的是一段连贯的视频。在这个视频中,每一帧都经过精心构思和计算,以确保它不仅能够与前后帧相匹配,还能够真实地反映文本提示中所描述的世界。每一次视频生成都是一个全新的创作过程,这是一种无限的艺术表现力,就像导演每次都能在同一个故事框架内讲述不同版本的故事。

可以说,扩展变换器是使Sora模型在视频生成领域大放异彩的秘密武器。它赋予Sora以理解和创造力,让AI不仅能够遵循文本提示,还能够在模拟现实世界的同时创造出引人入胜的视频故事。正是这种对故事情节、视觉细节和连贯性的关注,使得扩展变换器成为了Sora模型不可或缺的核心部分,它的高效和灵活在AI领域开启了新的创造性可能。

「写在最后」

再造一个新世界

随着Sora模型的问世,我们站在了人工智能技术迅猛发展的前沿。这不仅是对视频生成技术的一大突破,更意味着我们对物理世界模拟的理解和能力即将迎来新的革命。一直以来,我们渴望拥有一种工具,能够突破现实世界的限制,让我们自由创造和体验尚未存在或许永远不会发生的故事和场景。Sora模型就像是打开这扇大门的钥匙,引领我们进入了一个全新的虚拟创作领域。

譬如,导演们或许不再需要依赖昂贵的特效或繁复的场景布置,作家们的文字可以直接化身为生动的画面。教育者们可以借助Sora模型生成的视频,让历史教材上的事件重现眼前,或者是让复杂的科学概念通过动画得以形象演示。这种技术的普及可能会带来教学方法的颠覆性变化,让学习变得更加直观和生动。而对于设计师来说,这样的模型则意味着他们可以将概念设计快速转换为动态演示,极大提高工作效率和创作灵活性。

不仅是创意产业的专业人士,普通人也会发现这项技术极大丰富了他们的日常生活。随着Sora模型变得更加普及和易用,我们每个人都可以成为故事的创作者。无论是为了个人娱乐,还是为了与朋友和家人分享内心的想象,Sora都提供了一种全新的表达方式。我们能够看到自己构想中的世界被带到生活中,而这一过程仅仅需要我们描述出那个世界的模样。

在这项技术的推动下,我们的想象力和创造力的边界将被不断拓展。我们早已习惯了将想象的世界限制在文字描述和静态图像之内,但现在,随着视频生成模型的出现,故事和想象被赋予了动态的生命。或许有一天,我们回顾现在的时刻,会感到惊叹于自己正处于人类叙事方式如此深刻的转变之中。

从某种意义上来说,这样的视频生成技术,就像一个“造物主”,正在创造一个“世界”。这让我不禁思考,我们是不是也正活在某个“造物主”所创造的“世界”里面?

原文:https://mp.weixin.qq.com/s/CMydPM8qTU4EPzb5W7_9Og

AI视频生成初创公司,PIKA LABS官网入口网址