歪理大集合,谁也跑不了

发布时间:2024年06月06日

一边发文一边很是写了一点“歪理邪说”,有读者说因为自定义的话语体系,逻辑抽象读起来费劲,所以先简单梳理下。这类活好像之前都是雷·库兹韦尔、KK这些人干的,国内还有谁干这部分活没...

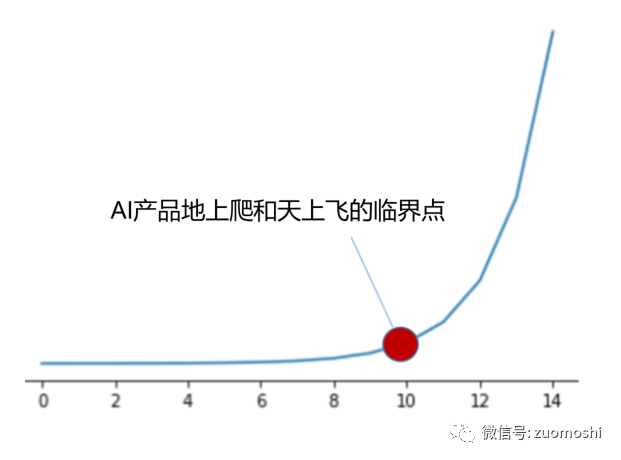

AI产品深井论

AI则是打深井式纵向挖掘,不管多大场景,AI需要把那个场景从头到尾整合完才能创造价值。比如做招聘的数字员工,如果不能把招聘全场景完全覆盖,这个数字员工就不创造超于正常员工的价值。这是一条指数曲线,过了某个临界点,AI产品的场景价值一下子会翻上去。

基本意思就是AI类系统应用有一个拐点,跨过去它的应用价值会指数翻翻,跨不过去就会在那儿爬着,其实chatGPT就这样。

系统型超级应用

未来的AI应用会具有下面四个特征:

第一,可以重用通行定义,基于感知进行智能判断并采取行动。(陆奇的大模型世界观说的也是这个)

这种感知和认知需要和IoT、现有各种系统做深度结合。

比如招聘场景就是公司最终需求岗位的描述和招聘平台的岗位,行动则是要能与候选人沟通,能办理入职等。

比如中央空调的场景就是气候、用量、当前温度等,行动则是空调温度控制等。

第二,要有价值序列的输入。

这不是感知的问题,比如什么是对的,什么是错的,在关键冲突的时候那个更重要等,比如还是中央空调的场景,用电量是不是可以无限飙升,还是说到某个限度就必须停下来,再比如招聘的时候

这不是感知,而是原则,并且也是绝对必须的,但似乎很少被提及。

第三,三个核心输入输出上都要要接受变化。

感知源和行动的风格肯定要根据不同的公司要有微调,比如同样是招聘的Agent,不可能期望用感知、行动和价值序列都一样的产品解决所有公司的问题。这最终必会导致应用商店和标准化的API接口。只有这样才能把大模型的通用能力投射出来。否则就有点像子弹是圆形,但枪管是方形。

第四,算法会是一组算法的组合。不可能就是大模型,其它模式识别类的估计一个也少不了,这些要集中提供。这会导致大模型、其它算法、领域模型、记忆、规划能力形成一套新的内核。这种内核要有通用性,否则一个是不匹配大模型的通用能力,一个是你也没法真的给人用。

大模型能力已经通用化了,再配上通用的结构,这种通用能力就能够彻底发挥,相当于给瓮中之脑加了一个终结者的身体。

所有这些都做完,就必然是系统型超级应用。

出处:AI Agent:大模型与场景间的价值之桥,但不适合当纯技术看

有效数据快速枯竭论

数据因为生产和消费的失衡而潜在的很快会枯竭。

把模型训练看成消费端,把人和物的所有行为看成生产端,那消耗的速度显然大于生成的速度。几十年积累的数据可以在几次训练中被消耗掉。

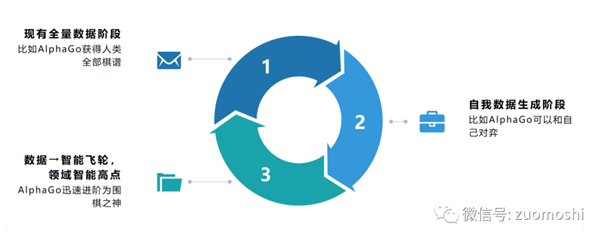

智能飞轮

智能飞轮是什么呢?基本上是九转金丹的方子(算法)、炉子(算力)和材料(数据飞轮)的综合。拿到了大概率炼出九转金丹,而吃了后基本立刻成仙。

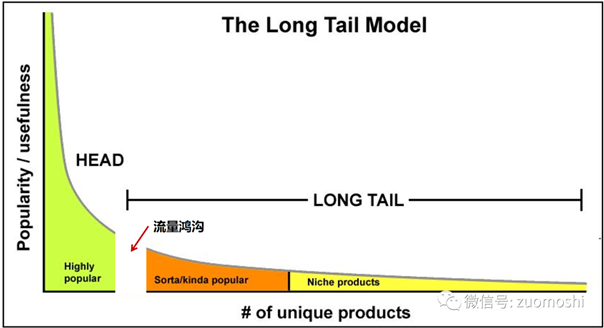

流量鸿沟

AIGC让内容膨胀之后,很可能流量分布上会两个趋势同时发生:一个是中心节点会有更大的增长量,一个则是一般的流量会被摊的更加稀薄,也就是上面说的一般人会更容易被淹没。

向更加靠谱的中心节点集中是因为不知道散布的信息是对是错,只能借助于传统的社会体系的筛选,一般的流量更加分散则是因为内容过多,流量还是那么多,内容变多,那平均下来肯定更加稀薄。

这就会产生一个流量的鸿沟。

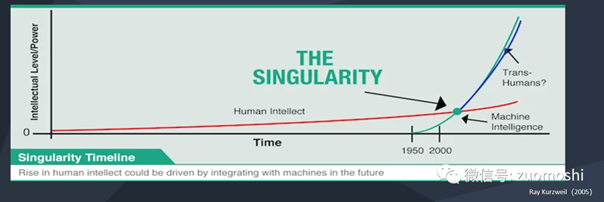

奇点临近的指数型增长新解/硅基崛起的内动力

当社会的变化和智能是指数型向上的时候,比如GDP增长,那意味着企业或者个人的事业必须是指数向上,否则就会被甩下来。道理很简单,如果平均GDP增长是10%,一个企业的增长则是5%,那大概率它会破产,而一个人的收入增长如果是5%,那很可能他会变的相对贫困。

而人的部分是不可能做出指数型增长的,所以能够匹配高速增长且不掉落,就只可能是基于大模型等技术的组织和个人。这是一种碳基智能和硅基智能找到合适边界的复合体。从这个角度看大模型确实也只能被拥抱,而不可能被规避。

赶不上增长速度呢?那会被甩落,然后考验社会的一般性承重。

名实唯一性

越数字和智能,一个类别潜在的越会往只有一个实例的方向发展,数字化、智能程度越高这种潜在趋势的内涵动能越大。

现实中很多例子,比如谷歌几乎逼近搜索这个类别,微信几乎逼近IM这个类别。

四维实体

如果我们把一个对象的全量信息,在全时空背景下做图,那它可能会像下面这样:

猫的情形下这种全量的时空特征才是特指的某个玳瑁或者橘猫的实例。

这种全量信息所形成的对象就是四维实体。

元方法

为了处理四维实体,那么有两个必须步骤:一个是识别出到底有那些四维实体,一个是四维实体之间的关系到底是什么。这个关系只是加减法,但1+1的结果可能是1也可能是0,不是我们经常学的那个数学。在过去辩证法是描述这种关系的,但它们之间的关系并不仅止于对立统一,量变到质变,否定之否定,还有其它的(庞朴:一分为三论里有其它一些描述)。

对于四维实体的识别而言必须持续反馈,对于关系而言1+1等于几不确定,但模式其实是定的。这种模式就是元方法。

在这个过程中驾驭这一切的是人的智能和灵性。这部分智能看不到被硅基智能取代的可能性,我们好像没法让人工智能处理1+1等于几不确定的事儿。

解决问题的工具就是问题本身(工具规定性)

解决问题的手段就是问题最大的原因。比如为了让人们过的更好,需要大禹治水,但随后就出纣王这样的人和系统,他们反倒是成为人们幸福的最大障碍。

科技道权

四维实体太多,其治理超过碳基生命的上限,必然产生科技道权。就是正视碳基智慧体的限制和缺陷,然后让硅基智能扮演角色来抑制它们。

大日核心与场域论

布道者、价值观和智能工具相融合形成一个像大日般的核心,笼罩特定的组织。它是一切力量的根源,但其中的你可自行选择生活方式;定义昼夜,但你可自择作息;决定温度的量级,但允许万物自行衍化;设定生命的起始条件,却又不规定生命本身;无可违反,却又两不相干;是规则也是力量,是尺度也是方法。

出处:到底什么是OpenAI成功的关键点,到底谁能干好大模型?

整体大于部分之和

机械体整体等于部分之和,生命体整体大于部分之和,组织从低级到高级正好体现机械体到生命体的过度。(这个很多老师在说,我就发挥下)

黑暗森林式思维是低级文明低级特征

对于黑暗森林,接受起来很自然,因为在漫长的历史上以及现实中,我们确实是这么想的也这么做的。当我强大的时候我抹杀你未必和你有关,我要确保你不要妨碍我成为我扩张的障碍。而所有帝王将相的传记反过来又用成王败寇在强化这种思维模式。在某个界限内,这是合理的,但当科技把人类力量强化到能按各种层次毁灭自己、成就自己的程度后,实际上这种思维就会变成一种让文明逆向旋转的力量。也就是说这是一种与低层次文明伴生的思维模式。这么搞人类肯定造不出来戴森球。

出自:https://mp.weixin.qq.com/s/jo2rc919Y5HNDkupbG0ULA

OpenTaskAI是一个创新的人才市场,专门为AI相关的自由职业者和业务需求搭建桥梁。使AI领域的自由职业者能够轻松地接触到各种业务机会。