阿里巴巴EMO:一张图片和音频即可生成谈话或唱歌视频

发布时间:2024年04月22日

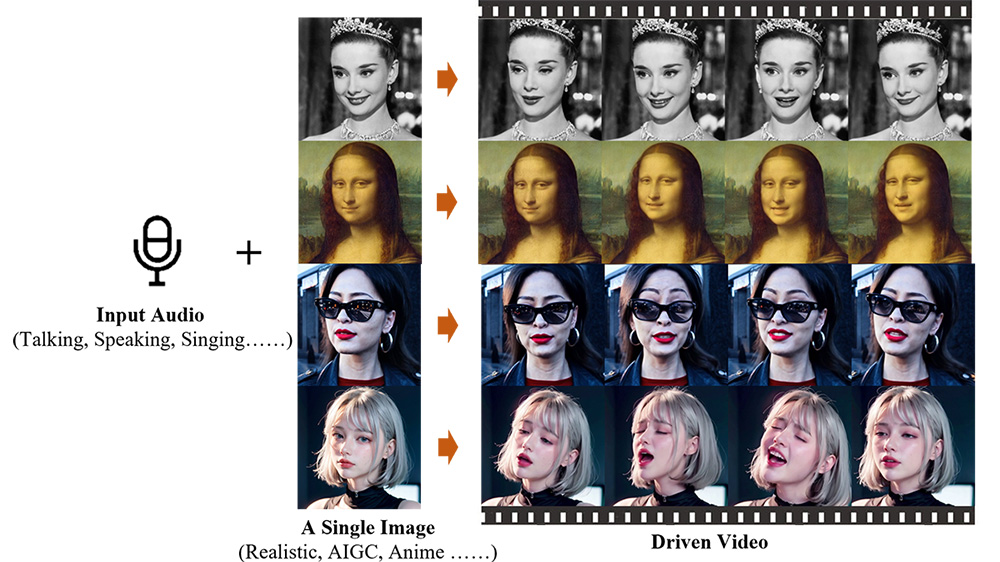

阿里巴巴集团智能计算研究院隆重推出EMO:Emote Portrait Alive,一种突破性的 AI,只需图像和音频即可生成富有表现力的人像视频!同时生成视频的长度和你音频长度相匹配,谈话和唱歌视频栩栩如生,支持任意语音、任意语速、任意图像...

与传统方法不同,EMO使用直接的音频到视频方法,绕过了对中间3D模型或面部标志的需求。确保了整个视频的无缝帧转换和一致的身份保留,从而产生了高度表现力和逼真的动画,这意味着更平滑的过渡和更自然的表情。

EMO甚至擅长制作各种风格的歌唱视频!想象一下,只用你最喜欢的艺术家的一张图片来制作音乐视频!

EMO研究论文:https://arxiv.org/pdf/2402.17485.pdf

EMO开源地址:https://humanaigc.github.io/emote-portrait-alive/

EMO主要功能:

1、音频驱动的人像视频生成: 利用单张参考图像和音频输入(如说话或唱歌),EMO能够生成具有表情变化和头部动态的虚拟人像视频。这意味着用户可以通过提供一张静态图片和相应的音频文件,来创造出说话或唱歌的动态视频。无论视频中的人物进行怎样的表情变化或头部动作,其基础特征都来源于这张参考图片。

2、表情丰富的动态渲染和头部姿势支持: EMO特别强调在视频中生成自然而富有表情的面部动作,它可以捕捉微妙的面部表情和头部运动,创造出栩栩如生的谈话和唱歌视频,从而生成看起来自然、生动的面部动画,增加了视频的动态性和真实感。

3、支持多种语言和肖像风格: 该技术不限于特定语言或音乐风格,能够处理多种语言的音频输入,并且支持多样化的肖像风格,包括历史人物、绘画作品、3D模型和AI生成内容等。

4、快速节奏同步: EMO能够处理快节奏的音频,如快速的歌词或说话,确保虚拟人像的动作与音频节奏保持同步。

5、跨演员表现转换: EMO能够实现不同演员之间的表现转换,使得一位演员的虚拟形象能够模仿另一位演员或声音的特定表演,拓展了角色描绘的多样性和应用场景。

EMO应用场景:

-

创建即时配音

-

为电影和视频游戏创建逼真且富有表现力的角色

-

开发引人入胜的互动教育材料

-

给虚拟助手一个更像人类的外观和感觉

-

让视频电话会议更具吸引力和个性化

-

制作更引人入胜、更令人难忘的营销和广告视频

实验结果表明,EMO不仅能够制作令人信服的口语视频,还能够制作各种风格的歌唱视频,在表现力和真实感方面明显优于现有的最先进的方法。为视频生成设定了新的标准,对于未来来说意义重大。

如果你想要了解关于智能工具类的内容,可以查看 智汇宝库,这是一个提供智能工具的网站。

在这你可以找到各种智能工具的相关信息,了解智能工具的用法以及最新动态。

未道帮AI,一个支持 AI 对话、AI 绘画和 AI 图像处理的强大生产力工具。